Comment l’on numérise le monde... étape suivante

Notre monde, tout préoccupé de numérisation, subit des hoquets de plus en plus rapprochés.

Pour comprendre ces difficultés, souvent occultées par la promotion du nouveau, il peut être utile de voir comment procède cette numérisation (tant vantée par M. Berry dans sa conférence inaugurale, au Collège de France) et notamment sa progression par vague successive. Chacune démarrant lorsque la précédente a verrouillé le processus et les habitudes qu’elle a permis de mettre en place.

Dans un premier temps, la numérisation n’est pas totale.

L’exemple de la musique permet de mieux s’en rendre compte.

Après être parvenu à coder (début de la démarche) le son de façon analogique (pour simplifier : un mouvement en créant un autre du même genre), la

numérisation proprement dite a consisté, à partir de l’échantillonnage (c’est-à-dire d’une "ressemblance trouée") à transformer ce son en une grille comportant suffisamment de barreaux colorés pour donner l’illusion du son premier.

Le son n’est pas créé à la ressemblance du premier (principe de l’analogie), mais abstrait du premier par une loi de correspondance.

Cette étape permet de faire des économies importantes (le but principal de la manœuvre), mais celles-ci restent limitées.

On s’en rend bien compte (... certaines oreilles non orthogonalisées par l’habitude d’entendre un son carré) en passant

d’un son codé par exemple en .WAV (CD audio) à celui correspondant, en .MP3, plus "léger", mais qui cogne de façon plus nette à l’oreille.

Cette première phase conclue, il est alors possible d’aller bien plus loin.

Car la numérisation totale n’est pas échantillonnage du réel, elle est son imitation (voir L’Intelligence artificielle) par

d’autres procédés.

C’est précisément ce que proposent des chercheurs d’une université américaine :

________________________________________________________

Sciences et technologies de l’information et de la communication

De la musique 1 000 fois plus légère que le MP3

http://www.bulletins-electroniques.com/actualites/53940.htm

Dans

la quête du volume minimum de données nécessaires au stockage d’un

morceau de musique, les chercheurs de l’University of Rochester ont

réussi à encoder numériquement un solo de clarinette de 20 secondes

dans un fichier de moins d’un kilooctet soit près de 1 000 fois plus

compressé que ne le permet la compression MP3.

Le

système repose sur une reproduction synthétique du son par

l’ordinateur. Ainsi, les informations contenues dans le fichier ne sont

pas constituées d’un échantillonnage de fréquences, mais d’une sorte de

partition spécifiant les actions à effectuer par un instrument pour

reproduire le morceau. En jouant la musique, l’ordinateur reproduit

littéralement la performance originale à partir de toutes les

connaissances acquises sur la clarinette et la façon d’en jouer.

L’équipe du professeur d’ingénierie informatique et électrique Mark

Bocko a donc mesuré chaque aspect ayant un impact sur le son produit

par la clarinette ; de la pression exercée dans l’anche pour chaque

doigté à la façon dont le son rayonne de l’instrument. Un modèle

informatique de la clarinette a ensuite été réalisé pour créer un

instrument virtuel construit entièrement grâce à des mesures empiriques.

(../..

____________________________________________

Economies d’importance puisqu’à terme ce n’est rien moins que l’instrument ET l’instrumentiste qui seront "économisés".

On peut penser, dans le cas évoqué par l’article que, dans un premier temps, comme le plus souvent, ce sera "la nouveauté en marche vers un progrès plus grand encore" que l’on vendra.

Biais indispensable pour faire oublier le caractère très approximatif du résultat (en dépit de ce qu’affirment ses promoteurs).

Le projet annoncé en fin d’article est de "traiter ainsi la voix".

En fait, à cela, l’homme travaille depuis assez longtemps, et l’on en trouve des

ébauches dans l’orgue de barbarie, puis dans la musique midi,

où chaque note est définie par ses paramètres puis reproduite par un

synthétiseur supposé contenir le modèle de production du son par

l’instrument.

C’est ce que propose, à quelques nuances près, le travail cité.

Et les limites de celui-ci sont de même nature que celles qu’a

rencontrées la musique midi en présence du monde des musiciens.

Dans le domaine des hautes technologies, il en va comme dans tout projet :

à partir d’un certain niveau de qualité, on atteint une limite au-delà

de laquelle le rendement est décroissant d’une manière qui rend

quasiment impossible la poursuite de son amélioration.

Chacun connaît (ou devrait connaître) les échecs des prétentions de l’Intelligence artificielle

des années 50, puis 70, (...) de la reconnaissance vocale, des tuteurs intelligents,

supposés créer des environnements d’apprentissage interactifs pour nos

bambins, etc.

Il en est de même pour la numérisation lorsqu’elle prétend à la synthèse (seconde phase) dans des domaines complexes comme l’art, ou plus généralement la vie.

Pour s’en convaincre il suffit d’écouter le son numérisé de la première manière (puisqu’il s’agit d’un fichier MP3 transmis informatiquement**)

et de le comparer au son que les scientifiques sont parvenus à rendre 1 000 fois moins encombrant (transformé ici en MP3 pour l’audition, mais le procédé dans ce cas n’a pas

occasionné de perte de qualité)

"la

méthode marche plutôt bien et il est difficile de discerner la musique

synthétisée de l’originale", déclare en guise de conclusion le Dr

Bocko.

Et vous qu’en pensez-vous ?

Evidemment, au-delà de l’aspect promotionnel, il faut reconnaître que, contrairement à ce qu’affirme le "Dr Bocko" la route est encore longue...

Assurément, pour gagner la moitié de la qualité qui sépare un son de

l’autre, le procédé perdra au moins la moitié de son avantage et le

gain ne sera au mieux que d’un facteur 500*** ... et ainsi de suite.

En effet, le nombre de paramètres qu’il faudra prendre en compte, pour rétablir un peu de cette présence "clarinette" est important, et les variables correspondantes peuvent être

très gourmandes (d’où une perte encore plus sensible au niveau du facteur gain).

On connaît bien cette progression géométrique et sa conclusion (c’est celle de la légende du jeu d’échec).

Très vite, le procédé devra alors réduire ses prétentions.

Deux choix se présentent :

- il est abandonné ;

-

il aura suffisamment modifié les habitudes d’écoute**** pour que la

qualité atteinte, sans trop perdre de son "gain" de place, soit

acceptable et devienne la nouvelle norme d’écoute.

C’est ce qui s’est produit, en

informatique, dans le domaine de l’enseignement, où massivement chacun

s’est replié sur les outils à interaction minimale que sont les

générateurs de QCM, les générateurs de simulations mécaniques, les

gestionnaires de flux d’information (un outil, synthétisant ces pratiques, a le vent en poupe : il s’agit du Tableau numérique interactif, muni à

présent de boîtiers de réponse façon QPUC*****).

Un doute subsiste pourtant :

toutes ces technologies n’ont-elles pas également un rendement

terriblement décroissant du point de vue de leur

composition-organisation ? (Lorsqu’elles s’ajustent les unes aux autres et doivent être gérées à différents niveaux.)

La montée en charge de la numérisation administrative, dans la plupart des pays, nous le dira.

Avec déjà quelques indications (exemples du quotidien).

Lecture d’un agenda par reconnaissance de caractère et synthèse vocale

Ce bambin (souhaitons-lui que sa mère parvienne à trouver la bonne adresse de la Caisse d’allocations familiales) aura peut-être la réponse à la question posée, pour laquelle on peut oser le pronostic : comme pour le couteau électrique acquis par tous les ménages qui le pouvaient dans les années 1970, certains usages de l’informatique iront sagement se ranger au font d’un placard, tandis que d’autres, correspondant réellement à des besoins, dans des fourchettes de coût et des conditions de réalisation admissibles, se verront banalisés et deviendront partiellement insensibles aux effets de mode, tout comme la forme définitive du marteau.

* Bien sûr, lorsque c’est l’effet recherché (certaines musiques en

jouent, il vaut mieux se faire l’allié de ses handicaps), tout va bien.

C’était le cas pour l’image numérique qui a tant vanté la disparition

du grain dans sa transformation en lumière pure cernée de contours

aussi nets que ceux des dessins animés.

Ce n’est pas toujours le cas et, de plus, peu à peu, les oreilles (et

les yeux finissent par se rendre compte du manque de grain... et, même

en rajoutant, par le calcul, un peu de désordre, la gêne subsiste).

** L’original est hors de portée de notre oreille... présentement.

*** Plus précisément se verra "enfler" de plus de la moitié de sa taille.

**** Tant de personnes regardent des images déformées sur leur écran

16/9e sans être choquées en quoi que ce soit de la distorsion.

***** Questions pour un champion. La compensation s’est faite, comme au

cinéma, dans le domaine des effets spéciaux, c’est-à-dire au niveau de

la forme.

15 réactions à cet article

Ajouter une réaction

Pour réagir, identifiez-vous avec votre login / mot de passe, en haut à droite de cette page

Si vous n'avez pas de login / mot de passe, vous devez vous inscrire ici.

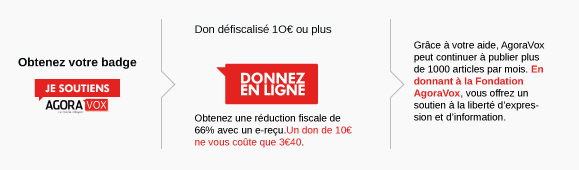

FAIRE UN DON